L’intelligenza Artificiale rappresenta sicuramente la nuova frontiera con la quale bisognerà confrontarsi. Lo ha capito bene anche l’UE che nel corso dell’ultimo anno, più precisamente dall’aprile del 2018, ha iniziato un percorso di assimilazione, armonizzazione e coordinamento nel sistema giuridico, in quello socio-economico e in quello etico e tecnologico di una Intelligenza Artificiale sicura, responsabile ed inclusiva.

Come riportato dal sito istituzionale della Commissione1, l’UE ha riconosciuto l’Intelligenza Artificiale come un obiettivo strategico chiave dell’evoluzione tecnologica, tanto da decidere di istituire una commissione ad-hoc per poter studiare i possibili approcci alla nuova tecnologia, impegno coronato nella stesura di un documento: Ethics guidelines for trustworthy AI.

La parola “Trustworthy AI” assume in tale ottica una dimensione decisamente rilevante, una intelligenza artificiale affidabile e fondata su tre principi cardine: quello della (1) liceità nel rispetto delle leggi, direttive e regolamenti applicabili, quello dell’(2) etica nel rispetto dei principi e valori etici che da sempre contraddistinguono il panorama europeo e quello della (3) robustezza e affidabilità intesa sia dal punto di vista tecnico che di inserimento nel tessuto sociale poiché, nonostante le buone intenzioni, una scarsa padronanza della tecnologia potrebbe involontariamente causare potenziali danni.

La connotazione ovviamente socio-economica, che da sempre caratterizza il mercato europeo, ha fatto si che tale Trusthworthy AI sia accompagnata dalle oramai granitiche garanzie di competitività che il mercato esige e da condizioni generali a salvaguardia dello sviluppo e utilizzo di tali tecnologie. Garantire un quadro etico e giuridico appropriato, basato sui valori dell’Unione e in linea con la Carta dei diritti fondamentali dell’UE, esige una rilevante valutazione delle norme esistenti in materia di responsabilità del prodotto, un’analisi dettagliata delle sfide emergenti e la necessaria cooperazione con le parti interessate, attraverso un’alleanza europea per l’intelligenza artificiale fondata su linee guida etiche.

La connotazione ovviamente socio-economica, che da sempre caratterizza il mercato europeo, ha fatto si che tale Trusthworthy AI sia accompagnata dalle oramai granitiche garanzie di competitività che il mercato esige e da condizioni generali a salvaguardia dello sviluppo e utilizzo di tali tecnologie. Garantire un quadro etico e giuridico appropriato, basato sui valori dell’Unione e in linea con la Carta dei diritti fondamentali dell’UE, esige una rilevante valutazione delle norme esistenti in materia di responsabilità del prodotto, un’analisi dettagliata delle sfide emergenti e la necessaria cooperazione con le parti interessate, attraverso un’alleanza europea per l’intelligenza artificiale fondata su linee guida etiche.

Il Progetto, oramai completato2, è stato preceduto da una dichiarazione di intenti comune tra i vari stati membri dell’UE3 e partito nell’Aprile del 2018 con una Comunicazione ufficiale della Commissione Europea al Parlamento al Consiglio, al Comitato Economico e Sociale (CESE), e al Comitato europeo delle regioni (CdR). L’iniziativa ha avuto come fine ultimo quello di pubblicare delle Linee Guida europee con un approccio etico all’intelligenza artificiale.

Dallo studio preliminare, che ha preceduto il testo definitivo, già si evinceva il ruolo che l’AI avrebbe avuto nelle dinamiche dell’evoluzione tecnologia: “L’AI ci sta aiutando a risolvere alcuni dei più grandi del mondo sfide: dal trattamento delle malattie croniche o alla riduzione dei tassi di mortalità negli incidenti stradali combattere il cambiamento climatico o anticipare minacce alla cybersicurezza.” 4 Addirittura il documento sottolinea l’importanza dell’intelligenza artificiale alla stregua dei decisivi cambiamenti occorsi durante la prima rivoluzione industriale del ‘700 che hanno portato il motore a vapore ad essere l’innovazione che cambiò l’intera società.

Gli obiettivi investimento e cambiamento socio-economico dell’Unione:

Oltre a sottolineare la consapevolezza dell’importanza dell’AI, la prima Comunicazione dell’UE offre numerosi spunti di riflessione sulle potenzialità e sul fine ultimo che la tecnologia potrebbe offrire:

– Nel campo della ricerca con la formazione di ricercatori e creazione di laboratori e startup di livello mondiale ma anche nel mondo della robotica5 e dell’industria per settori come trasporti, sanità e manifatturiero; l’UE ad oggi infatti è leader in molti settori tecnologici6 tanto da rappresentare una eccellenza a livello mondiale.

– Per il progresso del mercato unico digitale, progetto nel quale si inseriscono proprio le Linee Guida, con regole comuni, ad esempio sulla protezione dei dati e la portabilità dei dati nell’UE, la sicurezza informatica e la connettività che aiutano le aziende a creare valore e investimenti;

– per creare, elaborare, condividere dati industriali, del mondo della ricerca, sanità e del settore pubblico che possono sfruttare i sistemi di l’intelligenza artificiale per essere valore aggiunto al progresso (ad esempio i processi di deep learning e machine learning e le nuove frontiere del deep reinforcement learning un apprendimento per rinforzo che ha come obiettivo non solo l’apprendimento ma il compimento del sistema di vere e proprie azioni)7 8.

“No one is left behind in the digital transformation. AI is changing the nature of work: jobs will be created, others will disappear, most will be transformed. Modernisation of education, at all levels, should be a priority for governments. All Europeans should have every opportunity to acquire the skills they need. Talent should be nurtured, gender balance and diversity encouraged.”. “It is necessary to modernise Europe’s education and training systems, including upskilling and reskilling European citizens.” 9

Il progetto Horizon 2020 sicuramente deve essere considerato il progetto cardine nel quale le Linee Guida europee si inseriscono. Tale progetto prevede tra i tanti obiettivi quello di connettere e rafforzare i centri di ricerca in Europa, supportare lo sviluppo di una piattaforma di AI-on-demand10 che dia accesso a risorse rilevanti a tutti gli utenti, supportare lo sviluppo di applicazioni AI nei settori ritenuti chiave e strategici.

Il progetto Horizon 2020 sicuramente deve essere considerato il progetto cardine nel quale le Linee Guida europee si inseriscono. Tale progetto prevede tra i tanti obiettivi quello di connettere e rafforzare i centri di ricerca in Europa, supportare lo sviluppo di una piattaforma di AI-on-demand10 che dia accesso a risorse rilevanti a tutti gli utenti, supportare lo sviluppo di applicazioni AI nei settori ritenuti chiave e strategici.

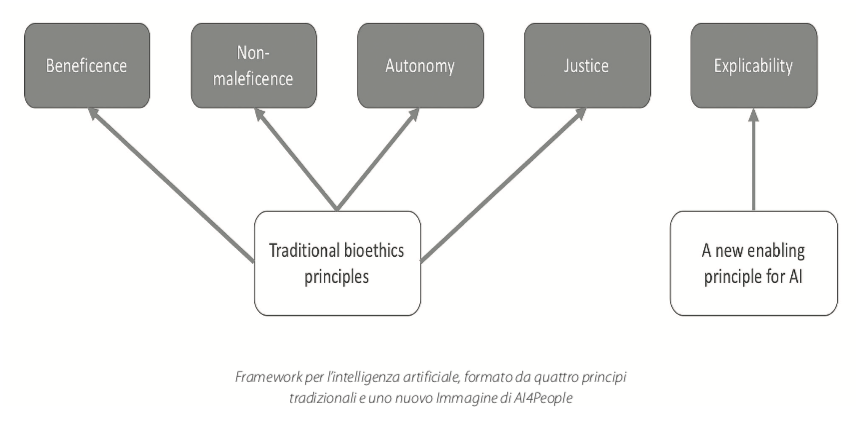

La prima Comunicazione dell’UE non tralascia quello che è stato il lavoro iniziato pochi mesi dell’inizio del progetto europeo e condotto da una task force di esperti riuniti sotto il nome di AI4People che ha esaminato quello che poi sono stati definiti gli “EGE Principles”. Il documento infatti delinea ben 36 principi etici suddivisi in quattro “Imperativi Etici”: rispetto e autonomia dell’essere umano, beneficenza (fare del bene) ovvero di non maleficenza (non nuocere), equità e giustizia, autonomia ed esplicabilità 11, principi integralmente poi sposati dalle linee Guida dell’Unione Europea 12.

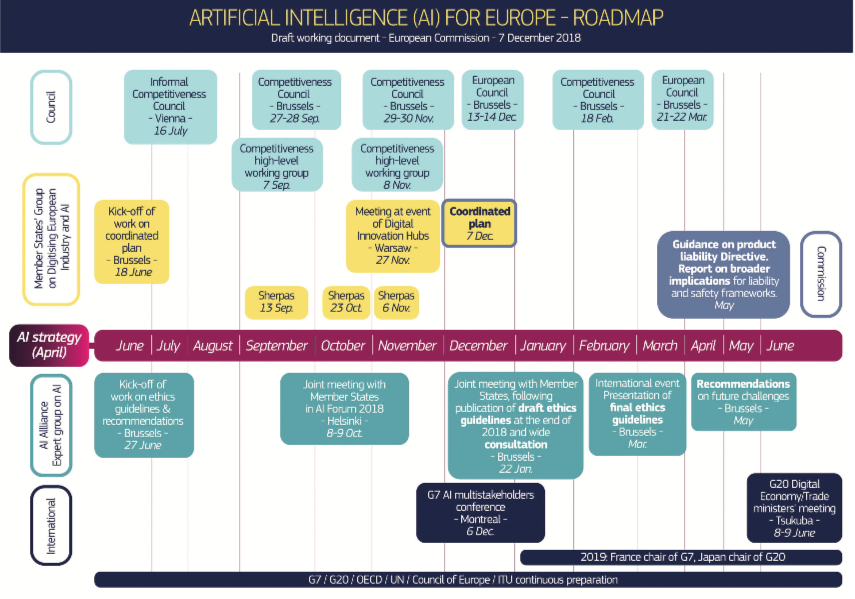

La Roadmap delle Linee Guida sull’etica dell’IA:

L’obiettivo primario dell’Unione era quello di creare un framework che coinvolgesse interlocutori in materia di AI ed esperti – l’Alleanza europea di Intelligenza Artificiale HLEG High-Level Expert Group13 in collaborazione con il Gruppo europeo di Etica delle Scienze e delle Nuove Tecnologie – per lo sviluppo di linee guida sull’etica dell’IA, nel doveroso rispetto dei diritti fondamentali, entro la fine del 2019.

Riassumendo l’infografica possiamo scandire esattamente quelli che sono stati i passaggi per la creazione delle Linee Guida etiche della “Trustworty AI”. Successivamente alla formazione e nomina degli esperti e una prima Comunicazione è stato pubblicato un primo Draft iniziale14 (il 18 dicembre 2018) e ufficialmente avviato un processo di consultazione con l’obiettivo di raccogliere feedback, commenti e proposte.

La consultazione si è conclusa il 1° febbraio 2019 con oltre 500 feedback ricevuti. Tali feedback analizzati e valutati dall’AI HLEG hanno prodotto una versione rivisitata e finale delle Linee guida sulla “Trustworthy AI” consegnata e pubblicata dalla Commissione Europea il 8 aprile 2019 15.

Lo scheletro delle linee guida:

L’Intelligenza artificiale come abbiamo visto genera valore sia per i singoli individui che per l’intera società tuttavia non bisogna sottovalutare i rischi da gestire adeguatamente che si celano dietro di essa. Nel complesso l’attenta valutazione del gruppo di esperti suggerisce come ad oggi i benefici dell’IA superino i rischi ad essa associati e proprio per questo è necessario “un approccio antropocentrico all’AI, che [ci] obblighi a tenere presente che lo sviluppo e l’utilizzo dell’IA non dovrebbe essere considerato come un obiettivo di per sé, ma come un mezzo per aumentare il benessere umano”.

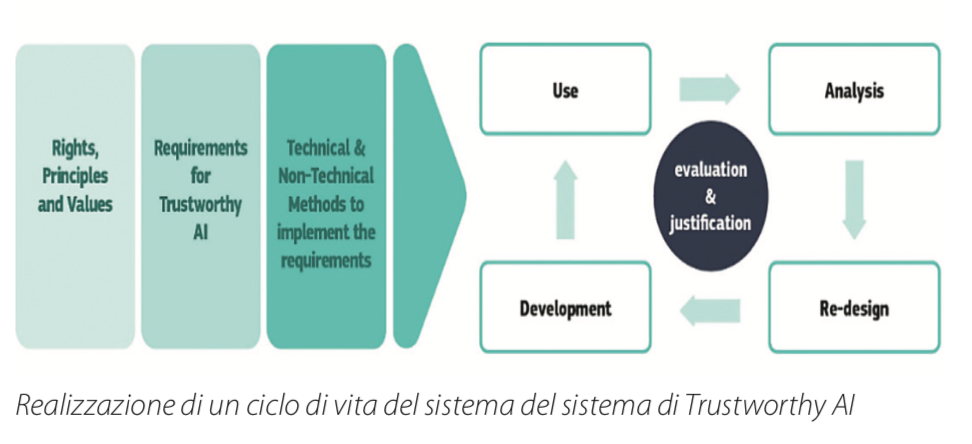

Il quadro descritto nell’elaborato finale presentato alla Commissione si suddivide in 3 capitoli:

1. Il capitolo I si riferisce alle modalità per garantire la finalità etica dell’AI, definendo i diritti, i principi e i valori fondamentali che dovrebbe rispettare quali il rispetto per l’uomo, l’autonomia, la prevenzione del danno, equità e chiarezza.

2. Partendo da tali principi, nel capitolo II viene elaborata una guida relativa alla realizzazione di un’IA affidabile, tenendo conto sia della finalità etica che della robustezza tecnica. A tal fine vengono elencati i requisiti per un’IA affidabile e si fornisce una panoramica dei metodi tecnici e non tecnici che possono essere utilizzati per la sua implementazione.

3. Il capitolo III infine rende operativi tali requisiti, fornendo una lista non esaustiva di controlli concreti ma non per la valutazione dell’affidabilità dell’IA. Tale lista viene successivamente adattata a casi d’uso specifici.

– La prima delle tre parti definisce i principi etici e sociali per valutare i possibili effetti futuri dell’IA sugli esseri umani e sul bene comune. L’IA dovrebbe infatti essere sviluppata, distribuita e utilizzata con “finalità etiche” che riflettono i diritti fondamentali, i valori sociali e i principi etici su cui sono basate e di cui si accennava sopra, vale a dire i quattro Imperativi Etici: rispetto e autonomia dell’essere umano, beneficenza (fare del bene) ovvero di non maleficenza (non nuocere), equità, autonomia, giustizia ed esplicabilità.

– Il Primo capitolo quindi riassume tutti i diritti fondamentali che non possono essere tralasciati se si affronta l’IA responsabilmente e nel pieno rispetto della Carta EDU.

Il “Rispetto della dignità umana”, l’idea che ogni essere umano possiede un “valore intrinseco”, che non dovrebbe mai essere sminuito, compromesso o represso da altri – né da nuove tecnologie come i sistemi di intelligenza artificiale.

La “Libertà dell’individuo” che con in un contesto AI, richiede, ad esempio, la mitigazione della (in) diretta coercizione illegittima, delle minacce all’autonomia mentale e alla salute mentale, della sorveglianza ingiustificata, dell’inganno e della manipolazione ingiusta.

L’ “Uguaglianza, la non discriminazione e la solidarietà” e cioè necessita di focalizzare particolare attenzione anche alle situazioni che coinvolgono i gruppi più vulnerabili, come i bambini, le persone con disabilità o le minoranze, o a situazioni in cui si verificano asimmetrie di potere o di informazione, ad esempio tra datori di lavoro e lavoratori, o tra imprese e consumatori.17

Il “Rispetto per la democrazia, la giustizia e lo stato di diritto”, dove tutto il potere governativo delle democrazie costituzionali è legalmente lecito e limitato dalla legge. I sistemi di intelligenza artificiale infatti dovrebbero servire a mantenere e promuovere i processi democratici e rispettare la pluralità dei valori e i bilanci degli individui.

L’esplicabilità che racchiude all’interno del proprio significato sia epistemologico di “intelligibilità” (come risposta alla domanda “come funziona?”) sia etico di “responsabilità” (come risposta alla domanda: “chi è responsabile del modo in cui funziona?”)

Riconoscere essere consapevoli del fatto che, pur apportando benefici sostanziali agli individui e alla società, l’IA può avere anche conseguenze negative. È necessario mantenere alta la guardia anche per gli ambiti più critici.

Oltre alle criticità individuate dal primo documento pubblicato, quello sintetico include anche tutti gli altri rischi che possono avere un impatto negativo, compresi gli impatti difficili da prevedere, identificare o misurare (ad esempio le ripercussioni che l’IA potrebbe avere sui sistemi giuridici democratici, sullo stato di diritto, sulla giustizia distributiva eche concerne la natura di una distribuzione di beni socialmente giusta) o addirittura sulla mente umana stessa.

– Il Secondo capitolo invece fornisce una guida su come l’IA attendibile può essere realizzata, elencando sette requisiti generali che i sistemi di intelligenza artificiale dovrebbero soddisfare. Gli esperti suggeriscono inoltre due differenti approcci uno tecnico e uno non-tecnico come possibili soluzioni per l’implementazione di tali requisiti.

I sette requisiti per una Intelligenza Artificiale Etica sono:

- Supervisione umana: i sistemi di intelligenza artificiale dovrebbero favorire lo sviluppo dell’equità sociale, sostenendo i diritti fondamentali, senza diminuire, limitare o fuorviare l’autonomia umana.

- Robustezza e sicurezza: la Trustworthy AI richiede algoritmi sicuri e sufficientemente robusti da contrastare gli errori e le inconsistenze durante l’intero ciclo di vita dei sistemi di Intelligenza Artificiale.

- Privacy e data governance: i cittadini dovrebbero avere pieno controllo sui propri dati, nella sicurezza che i dati che li riguardano non possano essere utilizzati a loro danno o a fini discriminatori.

- Trasparenza: deve essere garantita la tracciabilità dei sistemi di Intelligenza Artificiale

- Diversity, correttezza, assenza di discriminazione: i sistemi di Intelligenza Artificiale dovrebbero prendere in considerazione tutte le capacità e le skill umane, garantendo a tutti l’accessibilità.

- Benessere sociale e ambientale: i sistemi di Intelligenza Artificiale dovrebbero essere utilizzati per sostenere cambiamenti positivi, migliorare la sostenibilità ambientale e la responsabilità ecologica.

- Responsabilità: devono essere adottati meccanismi che garantiscano la responsabilità sui sistemi di Intelligenza Artificiale e sui loro risultati.

Al termine del secondo capitolo, il documento riassume alcune best practice da applicare all’AI per rendere i sistemi più efficaci:

- Promuovere la ricerca e l’innovazione per aiutare a valutare i sistemi di intelligenza artificiale e favorire il conseguimento dei sette requisiti; diffondere i risultati e coinvolgere il pubblico creando sistematicamente nuovi contenuti da condividere.

- Comunicare, in modo chiaro, proattivo e trasparente le informazioni alle parti interessate in merito alle capacità e ai limiti del sistema di intelligenza artificiale, consentendo valutazioni e aspettative realistiche e comunicare le modalità con i quali tali requisiti sono implementati.

- Facilitare la tracciabilità e l’audit dei sistemi di IA, in particolare in contesti o situazioni critiche.

- Coinvolgere le parti interessate in tutto il ciclo di vita del sistema AI. Incoraggiare la formazione e l’istruzione in modo che tutti i soggetti siano consapevoli e addestrati nell’IA

- Non dimenticare che potrebbero esserci sbilanciamenti importanti tra diversi principi e requisiti. Identificare, valutare, documentare e comunicare continuamente questi trade-off e le loro soluzioni.

Ma non solo, il secondo capitolo cerca di riassumere gli strumenti che si possono effettivamente implementare e sviluppare in termini di AI. Gli approcci tecnici, non- tecnici invece si suddividono in diverse categorie. Di seguito un elenco riassuntivo:

“Strettamente” Tecnici:

- Architetture per una Trustworthy IA

- Etica e diritto in base alla progettazione (X-by- design. Ad esempio privacy-by-design e security-by- design)

- Metodi e parametri di valutazione (chiamati Explainable AI – XAI)

- Test e convalida

- Indicatori della qualità del servizio

Non “strettamente” Tecnici

- Regolamenti

- Codici di condotta

- Standard e Certificazioni

- Governance e definizione di Ruoli e responsabilità

- Educazione e awareness per promuovere la mentalità etica

- Partecipazione delle parti interessate e il dialogo sociale

- Diversità e team di progettazione inclusivi.

– Il Terzo capitolo invece cerca di fornire una valutazione, non esaustiva, per rendere operativi i punti del secondo capitolo per l’applicazione del metodo tecnico – non tecnico di cui si accennava prima ed inoltre fornendo un questionario pilota sull’ Trustworthy Ai Assessment.

• Adottare un Risk Assessment approach idoneo per la Trustworth AI durante lo sviluppo, l’implementazione o l’utilizzo di sistemi AI e adattarlo al caso d’uso specifico in cui viene applicato il sistema.

• Ricordare che l’elenco di valutazione non sarà mai esaustivo. Garantire un AI affidabile non può essere un ticking box di una checklist, ma una identificazione e un’implementazione continua dei requisiti, una valutazione delle soluzioni per una garanzia di risultato dell’intero ciclo di vita del sistema AI e il necessario coinvolgimento degli stakeholder nel processo.

Gli esperti, nelle proprie raccomandazioni, sottolineano come il documento rappresenti un punto di partenza per aprire un serio dibattito sull’etica e l’AI e le sue applicazioni. Il framework orizzontale definito con il presente documento non deve essere preso come uno “standard” né tantomeno tenta di sostituirsi ad alcuna forma di regolamentazione attuale o futura, bensì invita ad esplorare le verticalità che la stessa AI potrebbe avere nell’impiego pratico dei singoli settori.

Gli Use Cases delle Linee Guida

L’ultima parte delle Linee riportano degli importanti esempi di Use Cases dove l’IA ha trovato applicazione. A titolo esemplificativo si cita uno dei tanti esempi che ben si sposa con i vari progetti che si sono interessati delle difficoltà nella formazione e nella ricerca delle risorse nei nuovi settori tecnologici 18:

Uno degli use case riportati è ad esempio il Quality education e digital transformation.

“I nuovi cambiamenti tecnologici, economici e ambientali impongono alla società deve diventare più proattiva. I governi, i leader del settore, le istituzioni educative e i sindacati devono assumersi la responsabilità di accompagnare i cittadini nella nuova era digitale, assicurando che abbiano le giuste competenze per riempire i futuri posti di lavoro. Le tecnologie AI affidabili potrebbero aiutare a prevedere con maggiore precisione quali posti di lavoro e professioni saranno interrotti dalla tecnologia, quali nuovi ruoli saranno creati e quali competenze saranno necessarie. Ciò potrebbe aiutare governi, sindacati e industria a pianificare la (ri) qualificazione dei lavoratori. Potrebbe anche dare ai cittadini che temono la ridondanza un percorso di sviluppo in un nuovo ruolo. Inoltre, l’intelligenza artificiale può essere un ottimo strumento per combattere le disuguaglianze educative e creare programmi educativi personalizzati e adattabili che possano aiutare tutti ad acquisire nuove qualifiche, abilità e competenze in base alla propria capacità di apprendere19. Potrebbe aumentare sia la velocità di apprendimento sia la qualità dell’istruzione, che va dalla scuola elementare all’università.”

Conclusioni

Horizon 2020 è sicuramente il progetto cardine che regge l’intera infrastruttura di investimenti europea per lo sviluppo tecnologico e che travolge trasversalmente una moltitudine di settori tra cui l’IA.

Fino ad ora il programma dell’UE ha finanziato più di 18.000 progetti di ricerca proprio sull’IA spendendo più di 30 miliardi di euro. Ha inoltre impegnato 1,5 miliardi di euro esclusivamente nella ricerca in ambito etico, aspettandosi che altri 2,5 miliardi arrivino da finanziamenti pubblici e privati. Sono invece previsti almeno 7 miliardi di investimenti tra i programmi di Horizon Europe (2021 – 2027) e Digital Europe20.

Sembrerebbe necessario a questo punto dover operare paragoni. Tra nazioni più impegnate nello sviluppo di tecnologie di intelligenza artificiale la Cina rappresenta sicuramente la prima nel panorama mondiale con la sua rivale U.S.A. in termini di competitività tecnologica.

Per riportare al lettore dei dati significativi, nella sfera etica e IA, la Cina, ha previsto un investimento totale di 13 miliardi a cui verranno aggiunti gli investimenti dei privati.21 L’intelligenza artificiale infatti è tra gli obiettivi politici del progetto madre “Made in China 2025” di Pechino che definisce l’ambizioso programma di condurre la Cina a diventare leader globale nel settore AI entro il 203022.

Il necessario dibattito che deve necessariamente instaurarsi tra Etica e Intelligenza Artificiale fa pensare molto al film di Isaac Asimov “I, robot” e alla contemporanea serie televisiva Westworld, dove le macchine, progettate per servire fedelmente l’uomo, si trasformano e si ritorcono proprio contro i propri creatori, punto che non dovrà essere mai raggiunto.

Concludendo “la Trustworthy AI può migliorare la prosperità individuale e il benessere collettivo generando prosperità, creazione di valore e massimizzazione della ricchezza. Può contribuire al raggiungimento di una società equa, contribuendo ad aumentare la salute e il benessere dei cittadini in modi che favoriscano l’uguaglianza nella distribuzione delle opportunità economiche, sociali e politiche” e che dovrà necessariamente tener conto dei potenziali rischi e pericoli che la stessa tecnologia potrà riverberare sull’uomo e sui sistemi innovativi.

Note:

1 https://ec.europa.eu/digital-single-market/en/artificial-intelligence

2 Le Linee Guida Ethicsguidelines for trustworthy AI sono state pubblicate su sito della Commissione Europea con il REPORT STUDY dell’8 Aprile 2019 – https://ec.europa.eu/digital-single-market/en/news/ethics-guidelines-trustworthy-ai

3 Elenco dei paesi firmatari della dichiarazione: Austria, Belgio, Bulgaria, Repubblica, Ceca, Cipro, Croazia, Danimarca, Estonia, Finlandia, Francia, Germania, Grecia, Ungheria, Irlanda, Italia, Lettonia, Lituania, Lussemburgo, Malta, Paesi Bassi, Polonia, Portogallo, Romania, Slovacchia, Slovenia, Spagna, Svezia, Regno Unito, Norvegia. – https://ec.europa.eu/digital-single-market/en/news/eu-member- states-sign-cooperate-artificial-intelligence

4 https://ec.europa.eu/digital-single-market/en/news/communication-artificial- intelligence-europe

5 L’intelligenza artificiale è presente nell’“EU research and developmentframework” dal 2004 con un focus specifico sulla robotica. Gli investimenti stanziati

sono aumentati fino a € 700 milioni per il periodo 2014-2020, investimento perfezionato dai € 2,1 miliardi di investimenti privati nel partenariato pubblico- privato sulla robotica. Questi sforzi hanno significativamente contribuito alla leadership mondiale dell’Europa nella robotica come il Progetto Sparchttps:// eu-robotics.net/sparc/

6 In Europa sono presenti le 100 migliori istituzioni di ricerca in tema di intelligenza artificiale del mondo. 32 Istituti di ricerca sono nella top 100 globale per pubblicazioni in tema di AI contro le 30 dagli Stati Uniti e le 15 dalla Cina. Fonte: Atomico, State of EuropeanTech, 2017. È da annoverare tra queste il Centro di ricerca tedesco per l’intelligenza artificiale (DFKI) fondato nel 1988 che ad oggi è uno dei più grandi centri di ricerca al mondo nel campo dell’IA.

7 Ulteriori ambiti di applicazione menzionati sono: intelligence e sorveglianza umana, safety, privacy e gestione dei dati, trasparenza, diversità e non discriminazione, equità e benessere sociale e ambientale, responsabilità

8 Per un esempio concreto di Deepreinforcementlearning sul tema, Un computer di Google ha battuto il campione europeo di un complicatissimo gioco da tavolo, https://www.ilpost.it/2016/01/28/go-alphago-google-deep-mind- intelligenza-artificiale/

9 https://ec.europa.eu/digital-single-market/en/news/eu-member-states-sign- cooperate-artificial-intelligence

10 https://www.ai4eu.eu/

11 L. Floridi, J. Cowls, M. Beltrametti, R. Chatila, P. Chazerand, V. Dignum, C. Luetge,

R. Madelin, U. Pagallo, F. Rossi, B. Schafer, P. Valcke, EJMVayena (2018), “AI4People —An Ethical Framework for a Good AI Society: Opportunities, Risks, Principles, and Recommendations”, Minds and Machines 28 (4): 689-707.

12 Non essendoci una traduzione ufficiale sono stati tradotti i seguenti principi dalla lingua inglese: Respect for human autonomy, Prevention of harm, Fairness, Explicability

13 L’elenco completo degli esperti è disponibile al seguente link: https://ec.europa. eu/digital-single-market/en/high-level-expert-group-artificial-intelligence

14 Sintesi scaricabile gratuitamente dal sito della Commissione Europea: https://ec.europa.eu/digital-single-market/en/news/draft-ethics-guidelines- trustworthy-ai

15 Le linee guida sono disponibili in versione Inglese al seguente link: https:// ec.europa.eu/futurium/en/ai-alliance-consultation

16 I diritti fondamentali sono alla base del diritto internazionale e dell’UE in materia di diritti umani e sono alla base dei diritti giuridicamente vincolanti garantiti

dai trattati dell’UE e dalla Carta dell’UE. Essendo giuridicamente vincolante, il rispetto dei diritti fondamentali rientra quindi nella prima componente dell’AI fidata (AI legittima). Tuttavia, i diritti fondamentali possono anche essere

intesi come riflessi di speciali diritti morali di tutti gli individui che sorgono in virtù della loro umanità, indipendentemente dal loro status giuridicamente vincolante. In tal senso, quindi, fanno anche parte della seconda componente dell’AI affidabile (AI etica).

17 Si vedano gli articoli da 24 a 27 della Carta dei diritti fondamentali dell’UE (Carta UE), che tratta dei diritti del bambino e anziani, l’integrazione delle persone con disabilità e dei diritti dei lavoratori. Vedi anche l’articolo 38 relativo alla tutela del consumatore.

18 In tema si suggerisce lo studio della Fondazione GCSEC con l’Università di Oxford: POLICY INTERVENTIONS AND THE CYBER SECURITY SKILLSSHORTAGE nelle due versioni: quadro internazionale, “Mind the Gap:The Cyber Security SkillsShortage and Public Policy Interventions” e il quadro italiano: “Il fenomeno del Cyber Security SkillShortage italiano nel contesto internazionale”, disponibili al seguente link: https://gcsec.org/it/policy-interventions-and-the-cyber- security-skills-shortage/

19 Esempio di tali progetti sono il progetto MaTHiSiS, volto a fornire una soluzione per un apprendimento affected-based e, comprendente dispositivi e algoritmi tecnologici di alto livello: (http://mathisis-project.eu/). Vedi anche la Watson Classroom di IBM o la piattaforma Century Tech.

20 UN Sustainable Development Goals, EU Agenda 2030, https:// sustainabledevelopment.un.org/?menu=1300

21 Accenture, How Artificial Intelligence Can Drive China’s Growth, 2017, https://www.accenture.com/_acnmedia/PDF-55/Accenture-How-Artificial- Intelligence-Can-Drive-Chinas-Growth.pdf

22 Attualmente la Cina già gode di un ampio vantaggio rispetto a molti altri paesi in termini di documenti accademici, brevetti e finanziamenti AI, sia transfrontalieri che globali)