Nei prossimi anni, il cyberspazio sarà confrontato allo sviluppo dell’intelligenza artificiale. Ciò aumenterà notevolmente l’efficacia potenziale degli attacchi informatici e costringerà tutti gli utenti del cyberspazio ad adeguare la loro protezione. Anche se in molti settori potrà beneficiare dell’intelligenza artificiale, l’esercito dovrà affrontare importanti sfide per mantenere le proprie capacità operative.

Introduzione

Lo scopo di questo articolo è quello di dimostrare l’importanza della sicurezza informatica come protezione contro i maggiori rischi che saranno generati dallo sviluppo e dall’integrazione dell’intelligenza artificiale (IA) nel cyberspazio. L’articolo si concentra sulla dimensione tecnica dell’evoluzione, ad oggi in atto, e su ciò che essa implica per le forze armate. Tuttavia, alcune considerazioni etiche o considerazioni sul ruolo dell’uomo in questo mondo di macchine – in senso filosofico – saranno inevitabili. Ciò che sta accadendo nel cyberspazio può portare a progressi fantastici, ma può anche diventare una grave minaccia in qualsiasi momento. I rischi che ne conseguono possono mettere a repentaglio la pace e la sicurezza internazionale.

Questa evoluzione è inevitabile e qualsiasi passo indietro è impensabile. L’utilizzo delle nuove tecnologie, in qualsiasi settore, fa parte della vita di tutti individui e della società1 e i benefici dell’IA giustificano molti compromessi. I progressi nelle tecnologie dell’informazione sono al tempo stesso promettenti e pericolosi. I nuovi strumenti possono promuovere la libertà e lo sviluppo, il progresso e il benessere, ma anche l’oppressione, la frode, la manipolazione e il controllo. I progressi tecnologici andranno a vantaggio di tutti, dai potenti ai deboli, dalle autorità giudiziarie ai gruppi criminali. Di conseguenza, le gerarchie e le autorità possono essere rafforzate o indebolite2 . Ciò avrà un impatto significativo sulla natura dei conflitti futuri. Se vogliamo controllare la crescita delle nuove tecnologie e soprattutto delle loro applicazioni, è importante anticipare e integrare rischi e opportunità.

L’IA rivoluzionerà la percezione e l’implementazione della sicurezza informatica, che diventerà una missione collettiva e permanente. Gli Stati e le infrastrutture critiche sono già oggi vittime di attacchi volti ad ottenere vantaggi di ogni tipo che siano essi politici, militari o economici. Lo spazio digitale è quindi già un vero e proprio spazio di confronto3 e gli attacchi informatici sono diventati la realtà quotidiana di una specie di nuova guerra fredda4 . Le società nel loro insieme, per via delle loro crescenti interconnessioni, diventeranno sempre più vulnerabili. I conflitti tra Stati, imprese o singoli individui potrebbero assumere forme finora ignorate. Ma una cosa è certa, che si tratti di conflitti nazionali o internazionali, politici o economici, tutti avranno una dimensione informatica sempre crescente. L’attore che riesce a prendere il sopravvento nella rete otterrà il sopravvento sul suo avversario 5. Gli attacchi informatici diventeranno più precisi e veloci. La sicurezza informatica da sviluppare in risposta a questa evoluzione deve essere vista come una costruzione di elementi multipli e complementari per creare un’architettura di sicurezza globale per il cyberspazio. Le capacità militari in questo settore possono, e devono, costituire una parte importante di questa architettura. La portata delle minacce digitali, specialmente quando vengono perpetrate con l’IA, non è ancora ben compresa. Per il momento, è necessario differenziare i rischi per le forze armate dai rischi per le aree civili così da poter immaginare quali azioni bellicose potrebbe intraprendere un aggressore.

Per questo motivo le forze armate, Esercito Svizzero compreso, devono essere all’avanguardia nella sicurezza informatica.

Prevenire l’invasione del territorio da parte di forze armate straniere può essere considerato il primo livello di deterrenza. Gli aggressori potrebbero rinunciare alle loro azioni di terra se non sono stati in grado di indebolire o paralizzare le forze armate del paese bersaglio prima delle operazioni. La resilienza, che mira ad un rapido recupero della capacità di azione, deve consentire l’impegno di mezzi immediato nonostante che il soggetto sia stato sottoposto ad un attacco informatico o che abbia subito qualche danno. È quindi chiaro che le forze armate hanno un notevole interesse a contribuire alla sicurezza informatica. Le nuove tecnologie che si utilizzeranno in futuro dovranno essere sicure perché devono essere in grado di svolgere la loro missione, anche in un ambiente cibernetico degradato.

Questioni relative allo sviluppo dell’intelligenza artificiale

La sfida centrale sarà quindi quella di sapere come gestire l’evoluzione attuale e le sue conseguenze per le forze armate, poiché questa evoluzione è inevitabile. Occorre individuare i cambiamenti di paradigma, che modificheranno concretamente la natura della vita sociale e delle relazioni tra i paesi. Le caratteristiche del mondo di domani saranno la volatilità, l’incertezza, la complessità e l’ambiguità. Il potere probabilmente sarà proiettato in un nuovo mondo e i conflitti armati convenzionali, come li conosciamo oggi, saranno in futuro solo fenomeni periferici. La sfida sarà quella di trovare un modo per sfruttare al meglio l’introduzione delle nuove tecnologie, proteggendosi al tempo stesso dai grandi rischi che esse creano. In questo contesto, la sicurezza informatica diventerà un obbligo dell’intero Stato e di tutti gli altri attori che possono beneficiare delle opportunità offerte dal cyberspazio o che ne sfruttano il suo regolare funzionamento.

Nel complesso, la minaccia principale deriva dal fatto che tutte le azioni avviate nel cyberspazio possono causare danni concreti anche negli spazi fisici, colpendo la popolazione civile, o addirittura causando vittime. Devono essere quindi previste le minacce che non esistono ancora e che saranno il risultato dello sviluppo delle nuove tecnologie e dell’IA. La minaccia informatica deve essere posta allo stesso livello della minaccia dei missili balistici o del terrorismo internazionale, per non parlare del fatto che tutte queste minacce possono essere combinate tra loro. Gli attori “non statuali” avranno la capacità di produrre gli stessi effetti degli attori statuali. Tuttavia, occorre tenere presente che gli attacchi, che hanno il potenziale di compromettere la sicurezza nazionale e la stabilità di uno Stato, richiedono risorse considerevoli.

I sistemi devono essere protetti nel loro insieme. Senza protezione, un aggressore può disturbare o interrompere molti servizi essenziali per la popolazione, come la distribuzione di acqua o elettricità, o gli scambi in generale. Ciò può portare rapidamente a gravi disordini sociali. Non sorprende quindi che gli attacchi informatici russi in Ucraina nel 2014 abbiano interessato centrali elettriche, banche, ospedali e sistemi di trasporto, nonché il corretto svolgimento delle elezioni. Gli esperti di teoria dei sistemi ritengono che se il 37% di un’infrastruttura viene distrutta, non funzionerà più. Secondo la “Revue Stratégique”6 , è possibile valutare la gravità di un attacco secondo 4 criteri7 . In primo luogo, è necessario (1) valutare il danno che potrebbe essere arrecato agli interessi fondamentali del paese, (2) analizzare le conseguenti violazioni della sicurezza interna, quindi (3) stimare i danni alla popolazione e all’ambiente e infine (4) all’economia.

Si può dire ad oggi che l’IA svolgerà certamente un ruolo importante nella sicurezza, sia in termini di capacità di difesa che di necessità di attacco. Per alcuni compiti e ruoli nel mondo della sicurezza, l’IA supererà molto probabilmente la capacità umana e porterà sicuramente nuove scoperte andando a controllare nuove tecnologie in una misura che va oltre le possibilità antropiche.

Il ruolo dell’IA per machine learning / deep learning è essenziale. I rapidi progressi in un’ampia gamma di

applicazioni si ottengono attraverso l’apprendimento automatico, molto più che attraverso la programmazione. L’intelligenza artificiale permetterà una fusione di mondi reali e virtuali per ottenere una migliore rappresentazione dell’ambiente. Questo apre nuove opportunità di formazione basate sulla maggiore capacità di raccogliere dati, analizzarli molto più rapidamente e sfruttarli istantaneamente.

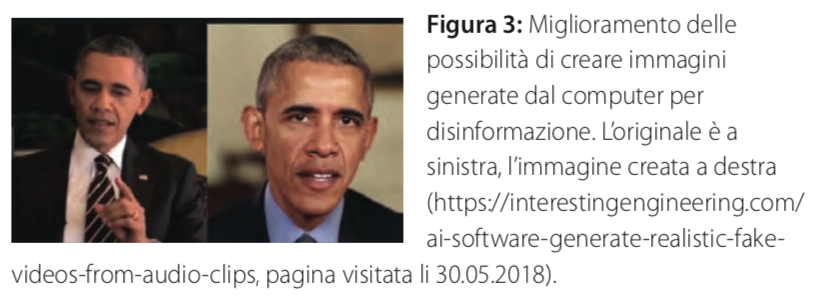

È prevedibile che l’IA aumenterà le minacce in tre modi diversi: espanderà e diversificherà le minacce esistenti, introdurrà nuove minacce e cambierà il carattere e la natura delle minacce note8 . Gli attacchi saranno più efficaci, più precisi, più difficili da attribuire ai veri responsabili e sfrutteranno sistematicamente tutte le vulnerabilità. L’IA fornirà anche capacità alle forze armate di identificazione di obiettivi umani (comandanti militari) o la navigazione autonoma. Sarà possibile realizzare campagne di disinformazione su larga scala con una portata inimmaginabile.

Di conseguenza, l’aumento dell’efficienza sarà una delle principali caratteristiche dei futuri attacchi nel cyberspazio che quindi, saranno preparati ancor meglio e con molta più attenzione9 . Grazie all’impegno dell’IA, gli attacchi saranno personalizzati e fatti su misura per raggiungere l’obiettivo desiderato. Di fronte a questo nuovo potenziale, l’interoperabilità tra esseri umani e macchine sarà una grande sfida. Una grande sfida connessa quindi sarà quella di trovare la migliore combinazione tra uomo e macchina. Occorre mantenere un certo livello di semplicità in modo che le informazioni possano essere utilizzate rapidamente dagli esseri umani. Troppe informazioni possono rivelarsi controproducenti, a tutti i livelli, in tutte le funzioni se fornite contemporaneamente, soprattutto nei comparti militari.

Una sorta di guerra meccanica, sistemi contro sistemi, non rappresenta fantascienza nel campo della sicurezza informatica. Le macchine d’attacco devono essere in grado di difendersi contemporaneamente da contrattacchi estremamente rapidi provenienti da sistemi precedentemente identificati.

I Robot sono divenuti importanti per la sicurezza in base a tre fattori principali10. In primo luogo il loro sviluppo e impiego. I robot infatti si stanno diffondendo e stanno divenendo un fenomeno globale. In secondo luogo la loro adattabilità ai più svariati usi che rappresenta un vero problema di sicurezza, e infine loro l’autonomia, il fattore più rischioso. È infatti possibile che la macchina voglia ribellarsi al controllo del soldato, e voglia portare a termine la missione nel modo che le sembra più razionale. Il controllo da parte dell’uomo potrebbe quindi apparire per la macchina come un elemento distruttivo e pericoloso e che quindi deve essere eliminato per portare a termine la missione. Uno dei maggiori pericoli di questa evoluzione è che alcune decisioni, che richiedono reazioni molto rapide e indiscutibili, potrebbero essere delegate all’IA come ad esempio l’impiego di missili o di armi nucleari11.

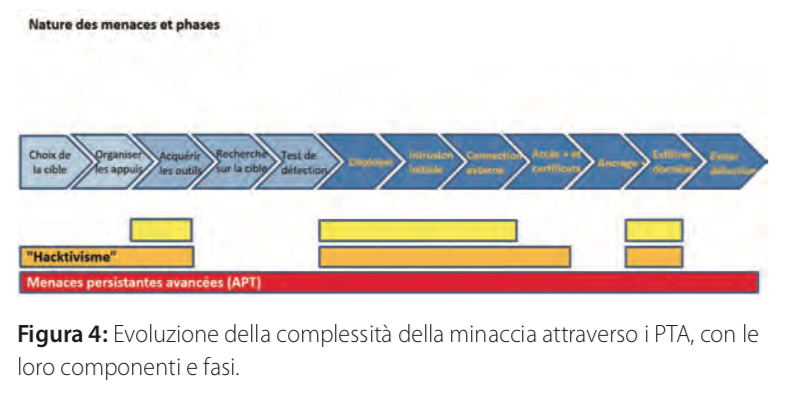

L’IA aumenterà anche l’efficacia degli attacchi informatici APT (Advanced Persistent Threats), che sono i più comunemente usati per lo spionaggio industriale. Questi strumenti sono molto utili per spiare le reti delle forze armate classificate perché sono difficili da localizzare. Grazie a questi APT, gli attori non statuali aumenteranno la propria capacità offensiva proprio come gli attori statali nel campo dello spionaggio.

Ma l’IA ha anche un impatto positivo sull’aumento della sicurezza. Esso apre nuove prospettive sulla capacità di rilevazione, contrasto e risposta agli attacchi informatici, anche quando il vettore di questi è ancora sconosciuto. L’IA è già coinvolta nel rilevamento di anomalie e malware nel cyberspazio.

Impatto sulle forze armate

Di fronte alla notevole minaccia potenziale rappresentata dall’uso dell’IA nel cyberspazio, le forze armate devono essere pronte a sostenere le autorità civili in caso di una grave destabilizzazione della società. Nella maggior parte dei casi, i rischi per le forze armate devono essere dedotti dai rischi per le aree civili, al fine di immaginare quali azioni dolose potrebbe intraprendere un aggressore. Sarà necessario un ambiente sicuro nel ciberspazio, in modo da poter integrare gli sviluppi positivi e da evitare che il loro potenziale generi disastri. Considerando le opportunità e i rischi potenziali, si tratta di definire il modo migliore per le forze armate per sfruttare le opportunità e proteggersi dai rischi. In primo luogo, devono garantire il loro corretto funzionamento al fine di fornire servizi di sicurezza a vantaggio dello Stato.

Sicuramente inizierà un nuovo dibattito. Per quanto riguarda i conflitti e i combattimenti, gli sviluppi in corso e le nuove tecnologie si trasformeranno in mezzi per causare ancor più danni attraverso una maggiore precisione ed efficienza nella realizzazione dell’obiettivo. Questi nuovi sistemi permetteranno di distruggere i mezzi dell’avversario in modo più efficace. In questa logica, le nuove tecnologie sono utilizzate solo come vettori per migliorare ciò che è già possibile oggi. Se cambiamo paradigma, è ovvio che dobbiamo chiederci se un nemico può essere sconfitto senza nemmeno combatterlo, con altri mezzi.

Penetrare una rete può anche essere più vantaggioso dell’introduzione di un nuovo insieme di armi. La distruzione fisica dell’avversario non sarebbe quindi né necessaria né fine a se stessa e la natura stessa della guerra non solo evolverà, ma cambierà completamente. L’IA e le armi informatiche hanno un alto grado di flessibilità che consentirà grazie al loro impiego di produrre un’ampia gamma di effetti. L’energia sarà proiettata in un nuovo modo e i conflitti, così come li conosciamo, tenderanno a diventare fenomeni periferici, spesso guidati da intermediari. In questo nuovo tipo di lotta, le possibili conseguenze per le popolazioni civili non appaiono ancora chiare.

Evoluzione della natura dei conflitti e delle forze armate

Di conseguenza, sorgono molte domande sulla natura mutevole dei conflitti. La questione fondamentale è se la guerra informatica diventerà la guerra del futuro, ancor più del confronto con i sistemi d’arma robotica. Questo avrebbe conseguenze molto importanti per la dottrina. L’avversario potrebbe essere sconfitto da azioni nel cyberspazio che lo priverebbero dell’uso di tutte le sue infrastrutture critiche e gli impedirebbero di agire. In secondo luogo, non è chiaro se le armi nucleari e i sistemi d’arma con effetti devastanti saranno ancora utili. Potrebbe infatti essere possibile bloccare la capacità di impegnare quest’ultime attraverso il cyberspazio, o renderle inefficaci. Analogamente, le armi informatiche potrebbero, se necessario, causare tanti danni quanto le armi nucleari. In tal caso, la capacità di sviluppare azioni nel cyberspazio diventerà la chiave del successo, una sorta di deterrente per il futuro. Ciò implica che l’intimidazione di un avversario e la dimostrazione della forza avverrà attraverso il cyberspazio e attraverso azioni che, almeno in una prima fase, avranno probabilmente un impatto scarso o nullo sulla popolazione civile. Ma nel caso di paralisi di interi settori dell’economia di un paese, lo scoppio volontario di disastri tecnologici o ecologici, con molte vittime, o anche durante la manipolazione grossolana del processo democratico, è probabile che siano annunciati veri e propri atti di guerra.

La difesa nel cyberspazio deve quindi far parte degli strumenti di tutte le forze armate se si vuole che esse assolvano la loro missione di difesa e protezione della popolazione civile. La dimensione informatica è una dimensione crescente di tutti i compiti svolti dall’esercito, dalla pianificazione della condotta, alle infrastrutture e ai processi. Tutti gli elementi del cyberspazio svolgono un ruolo di moltiplicatore delle forze coinvolte12. Di particolare interesse è il fatto che gli attacchi informatici non solo sono accurati, ma anche molto veloci (velocità della luce). Le forze armate occidentali, che fanno ampio uso di nuove tecnologie impiegate in tutto il mondo, si confrontano costantemente con i rischi associati al loro uso nel cyberspazio. Tale impiego è spesso un prerequisito per lo svolgimento delle loro operazioni, come il consolidamento della pace o gli impegni umanitari in zone remote.

L’importanza del cyberspazio nella pianificazione e nello svolgimento delle operazioni è spesso sottovalutata, nonostante il fatto che grazie ad essa molti obiettivi militari possano essere raggiunti. E’ possibile disturbare e interrompere scambi di dati (comunicazioni di ogni tipo), impedirvene l’accesso, corromperli o danneggiarli infettandoli o rendendoli inutilizzabili. Ma l’obiettivo può essere più facilmente quello di distruggere parte dei dati nei computer o addirittura compromettere le banche dati o bloccare le reti. In generale, è possibile considerare l’implementazione di un malware nei sistemi informatici dell’opponente come un’assicurazione in caso di attacco, o come una preparazione a lungo termine per i casi di contrasti o controversie. In questo caso, c’è un forte interesse a non rilevare l’attacco. D’altro canto, se uno Stato utilizza armi su larga scala nel cyberspazio, con l’intenzione di causare danni significativi al suo avversario, lo fa con una certa finalità, e quindi non ha necessariamente interesse a rimanere nascosto. Al contrario, si rivelerà per ottenere ciò che sta cercando13.

L’intelligenza artificiale come sfida per le forze armate

Gli attacchi nel cyberspazio saranno sempre più utilizzati perché il tempo, la distanza, la velocità e il ritmo non hanno più un ruolo primario non costituendo più vincoli e potendo anche essere automatizzati. È possibile che gli effetti prodotti dalle azioni nel cyberspazio contro avversari non convenzionali possano essere più difficili da ottenere, o più limitati, se questi ultimi non sfruttano le reti informatiche per i propri processi e i propri sistemi d’arma. Nel caso dell’Ucraina nel 2014, il mantenimento di alcuni controlli manuali ha reso più agevole la reazione dopo un attacco informatico all’infrastruttura di produzione di energia elettrica. Gli attacchi informatici contro l’Estonia, la Georgia e l’Iran non sono stati percepiti da questi paesi come un attacco militare in quanto tale e quindi non hanno avuto alcun impatto sulle loro forze armate. Si tratta di una questione di interpretazione, poiché la distruzione di una capacità chiave si può ritenere sia un attacco all’intero paese. Occorre anche considerare l’importanza che il cyberspazio ha a seconda delle fasi di un conflitto o se, al contrario, tale importanza persiste, eventualmente anche dopo la fine delle ostilità. Sarebbe quindi sbagliato considerare il cyberspazio come uno spazio operativo utilizzato solo o principalmente durante le fasi iniziali di un conflitto e altrettanto che le opportunità, quindi l’importanza del cyberspazio, diminuiscano durante il conflitto.

Nonostante le considerazioni di cui sopra, ci sono ancora alcuni autori che ritengono che la minaccia della cyberguerra non sia una minaccia grave per le forze armate.

Essi percepiscono le azioni nel cyberspazio come misure parallele al conflitto tradizionale o addirittura ibrido, mentre gli scambi nel cyberspazio sono descritti come schermaglie. Per questo motivo è necessario esaminare in dettaglio l’impatto che l’IA potrebbe avere sulle forze armate. Le conseguenze rivoluzionarie dell’IA sulla sicurezza costringeranno le forze armate a fare un salto di qualità. Non saranno più in grado di accontentarsi delle evoluzioni qualitative per adattarsi ai nuovi prodotti.

In particolare, l’IA e l’e-learning avranno implicazioni decisive per la sicurezza informatica e la guerra informatica. Per quanto riguarda la condotta di un conflitto, il salto qualitativo deve essere considerato alla stregua di quello che si è verificato con l’emergere dell’aviazione.

Più che nello svolgimento di combattimenti dinamici, le forze armate con l’IA avranno un importante vantaggio nell’adempimento della loro missione di sicurezza sociale. L’intelligenza artificiale analizzerà e fonderà l’enorme volume di dati. In particolare nel campo dell’intelligence, le attività che attualmente richiedono molte persone, potranno essere automatizzate. L’esercito avrà una maggiore capacità di raccogliere dati, analizzarli molto rapidamente e utilizzarli immediatamente. La lotta per la superiorità nello spazio dell’informazione diventerà feroce, decisiva.

L’IA genererà opportunità di formazione in mondi che combinano informazioni reali ed elementi virtuali e consentirà, anche a distanza, un livello di prontezza operativa senza precedenti. L’intelligenza artificiale può quindi rivelarsi uno strumento prezioso nella fase iniziale dei conflitti o quando magari un attore non vuole o non è in grado di impegnare truppe per raggiungere l’obiettivo.

Lo spionaggio di sistemi nemici, come misura preparatoria al combattimento, diventerà sempre più importante e sarà il primo passo di una guerra. Questa raccolta di informazioni servirà come base per attività di sovversione, come la mobilitazione a fini politici e l’influenza sull’opinione pubblica, compresa la manipolazione delle informazioni. Sarà inoltre utilizzato per preparare il sabotaggio di impianti, sistemi d’arma, infrastrutture critiche, e il disturbo o la compromissione della natura delle comunicazioni14. Tutte azioni, queste, che indeboliscono l’avversario e quindi preparano il campo di battaglia. D’altro canto però è sbagliato assumere che tutte le guerre cominceranno sistematicamente con una fase di guerra informatica, poiché attori isolati saranno sempre in grado di agire direttamente ricorrendo ad azioni violente.

Anche nel campo dei materiali e delle attrezzature in generale, l’IA avrà un impatto importante. Consentirà di controllare le nuove tecnologie molto meglio degli esseri umani. Le nuove capacità dei robot combinate con l’intelligenza artificiale permetteranno di colpire con una precisione millimetrica15. La programmazione dei sensori, soprattutto quando possono innescare una risposta automatica, sarà migliorata e diventerà cruciale e concreta. L’automazione accoppiata con l’IA permetterà lo sviluppo di “fire and forget” con applicazioni su un gran numero di sistemi; da qui la necessità di sviluppare in parallelo le capacità di controllo umano sull’impiego di queste armi. Le forze armate vorranno sfruttare appieno i vantaggi delle macchine nello svolgimento dei combattimenti. Allo stesso tempo, si parla anche di materiali che non solo sono più leggeri e più isolanti, ma che potrebbero anche cambiare forma e colore. Se questi materiali sono combinati con l’intelligenza artificiale, c’è un grande potenziale per il loro uso, in particolare nel camuffamento, ma anche nel migliorare le prestazioni dei soldati.

Le possibilità dell’intelligenza artificiale nello svolgimento delle operazioni militari

La combinazione della massa di dati disponibili e dell’IA nel cyberspazio indebolirà la volontà di resistere da un punto di vista psicologico. Questa capacità sarà utile sia per la difesa che per l’attacco. In generale, la progettazione degli attacchi sarà sempre più accuratamente adattata all’obiettivo per garantirne la sua efficacia. Pertanto, nel campo della disinformazione, le possibilità che questi attacchi avvengano si amplificherà e la loro diffusione si realizzerà ad un ritmo molto rapido. L’IA diventerà così un supporto essenziale per lo svolgimento delle operazioni, soprattutto a causa del suo elevato potenziale analitico. L’IA apre nuove dimensioni a questi potenziali miglioramenti, soprattutto nella ricerca delle vulnerabilità dei sistemi opposti.

L’IA consentirà inoltre di sviluppare supporti ai combattenti attraverso sistemi autonomi. L’estensione della capacità di svolgere autonomamente le missioni sarà una caratteristica della futura forma di combattimento. L’umano, attraverso l’IA, cercherà di reagire ai cambiamenti più velocemente e meglio dell’avversario, il che gli procurerebbe un guadagno sostanziale sul campo di battaglia.

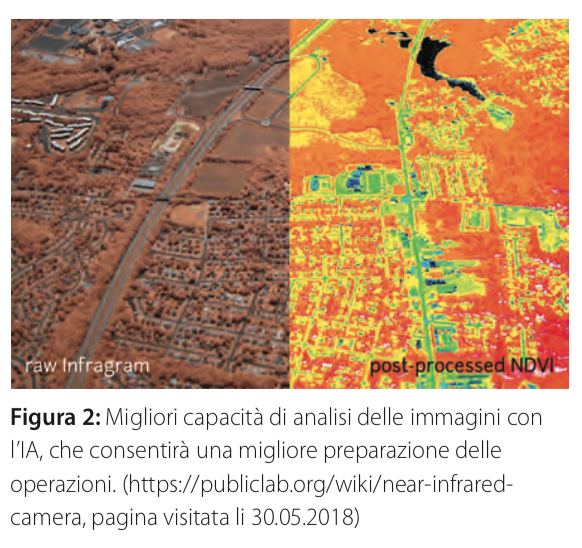

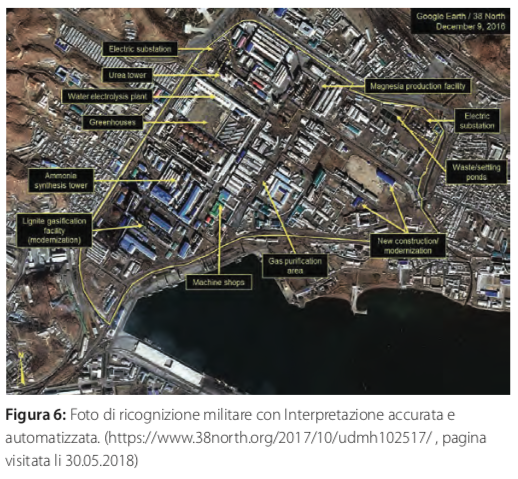

L’IA permetterà di combattere contemporaneamente una moltitudine di sistemi, nel mondo reale e virtuale, e permetterà il contrasto di una successione di attacchi ravvicinati e di diversa natura. Sarà in grado di coordinare le difese, stabilire le priorità e agire con estrema rapidità. L’intelligenza artificiale consentirà, altresì, una migliore analisi degli obiettivi potenziali, soprattutto attraverso controlli incrociati delle informazioni. Ciò vale anche per l’analisi delle immagini collegate ad altri dati come ad esempio l’identificazione delle infrastrutture critiche e il momento migliore per attaccarle. Questo potrà avvenire ibridamente sia attraverso attacchi informatici che attacchi convenzionali.

Ma l’intelligenza artificiale può supportare le truppe anche in aspetti meno tecnici, ad esempio nel campo della psicologia con analisi di contenuti violenti che minano il morale delle truppe.

Nel campo della protezione fisica, riduce i rischi, in particolar modo per le ricognizioni nelle zone nemiche o per lo sminamento, operazione queste che potranno essere effettuate da robot.

Sarà possibile preservare gli esseri umani assegnando compiti «3D» (dirty, dull and dangerous, i.e. sporchi, opachi, pericolosi) a macchine dotate di IA. Anche il processo decisionale può essere migliorato con l’IA, così come il collegamento di diverse unità, la simulazione operativa per la preparazione delle operazioni. Aumenterà l’efficienza e le prestazioni dei sistemi di combattimento e verranno semplificate le funzioni logistiche di supporto, soprattutto nella manutenzione. Proprio per tali ragioni i computer con IA diventeranno sempre più sistemi d’arma. Le armi informatiche diventeranno così una sorta di super-armi di disturbo16 e di indebolimento.

Tuttavia, ci sarà sempre una grande differenza tra la sicurezza, che può essere migliorata nelle aree urbane o in alcune infrastrutture come stazioni o aeroporti, dove sono installati un gran numero di sensori come le telecamere di sorveglianza e le cui immagini sono disponibili e possono essere analizzate, e il combattimento dinamico in un ambiente in cui non sono disponibili sensori fissi.

Data la portata dell’azione, durante un’operazione, l’installazione su larga scala di sensori continuerà ad essere un ostacolo che lascerà inevitabilmente spazio a sorprese.

A causa della crescente integrazione dell’IA nei sistemi delle forze armate, il campo di battaglia subirà diversi cambiamenti. In primo luogo, in tutti i settori ci sarà un rimpiazzo su larga scala degli esseri umani con robot autonomi, dalla logistica al combattimento.

Naturalmente, questi robot avranno diversi gradi di autonomia a seconda dei loro compiti. Si tratterà di determinare per ogni compito quale sia il grado minimo di controllo umano richiesto. A lungo termine, gli aerei da combattimento diventeranno parzialmente obsoleti e potranno essere sostituiti da sciami di droni per missioni ben definite.

Questa tendenza sarà sostenuta dal forte calo del costo dei droni. Per le forze di terra si dovrà trovare una soluzione per poter reagire ad un attacco di centinaia o migliaia di droni. Analogamente, cariche esplosive improvvisate diventeranno armi di precisione, moltiplicando il potenziale di qualsiasi gruppo terroristico, ad esempio con un’auto kamikaze che viaggia autonomamente.

Il potenziale dei gruppi armati di destabilizzare una società, come parte di una strategia ibrida, aumenterà. Questi gruppi potrebbero utilizzare robot per effettuare assassinii automatizzati su larga scala di funzionari militari, politici ed economici. Tuttavia, l’IA sarà anche in grado di sostenere il disarmo di questi gruppi identificando le transazioni sospette e, più in generale, identificando potenziali terroristi attraverso l’analisi di blocchi di infomazione. Le difese passive e attive potranno essere migliorate anche per obiettivi di alto valore come le infrastrutture critiche (armature, difese attive, radar UAV, ecc.).

L’apprendimento più o meno automatizzato dell’IA sarà una materia centrale. Una importante vulnerabilità si avrà non appena un aggressore riesce a violare un determinato processo di apprendimento.

Ciò può essere ottenuto aggiungendo elementi di disturbo, come false informazioni su cui si basa l’apprendimento o modificando leggermente la percezione dell’ambiente da parte delle macchine per causare comportamenti diversi e potenzialmente pericolosi.

Ad esempio, il riconoscimento di amici-nemici può essere invertito nella fase di apprendimento o si possono predisporre i sistemi d’arma autonomi, per colpire specificamente i civili.

L’apprendimento automatizzato diventerà un obiettivo in sé, poiché sarà interessante sabotare il potenziale dell’avversario da questa fase, rallentare le capacità di miglioramento dei sistemi d’arma autonomi e spiare o prevenire l’assunzione di funzioni sempre più importanti da parte dei robot con l’IA17.

Nonostante ciò, l’IA ci costringerà a dare maggiore autonomia alle macchine, per permettere loro di utilizzare il potenziale, soprattutto per quanto riguarda la velocità delle loro reazioni. In questo senso, l’essere umano diventerà un fattore di rallentamento. Se limitassimo l’autonomia e la velocità delle macchine per garantire un miglior controllo, corriamo il rischio che l’avversario sia più veloce. Non ci sarà quindi alcuna scelta e si paventerà il rischio reale che gli esseri umani diventino spettatori di interazioni tra macchine, fino ad includere le battaglie tra loro.

L’esempio dei droni è significativo. L’aumento esponenziale del loro numero per i compiti più diversi è problematico perché aumenterà il rischio di azioni incontrollate. In ultima analisi, si tratterà di individuare i sistemi d’arma che non possono funzionare senza il supporto dell’IA, proprio per adottare misure di protezione adeguate e garantire la ridondanza di tali sistemi.

Le vulnerabilità dell’intelligenza artificiale

La crescente integrazione dell’IA nei sistemi e nei processi dell’esercito solleva molti interrogativi sui possibili effetti negativi e sulle misure necessarie per tenere sotto controllo i rischi. L’obiettivo finale è quello di impedire che sistemi o processi militari siano distolti dal loro uso primario. In generale, il tema è come un ambiente cibernetico degradato possa interferire con la capacità delle forze armate per portare a termine la missione partendo dalla mobilitazione per arrivare al combattimento.

È possibile che gli sviluppi tecnologici, o la loro implementazione nell’esercito, possano essere ostacolati a causa dei rischi connessi. Non appena si parla di armamenti e controlli, più o meno automatizzati, dobbiamo essere in grado di garantire che il controllo sia mantenuto, o che si escluda un’acquisizione o una riprogrammazione da parte dell’avversario. Sarà quindi particolarmente importante rafforzare la sicurezza e la protezione dei sistemi18.

Le vulnerabilità saranno attivamente ricercate e inevitabilmente attaccate. L’integrazione dei sistemi di IA nelle forze armate sarà soggetta a vincoli significativi ma inevitabili. Una sfida importante sarà quella di trovare la migliore combinazione tra uomo e macchina, per sfruttare al meglio le potenzialità dell’intelligenza artificiale e le sue sinergie. Si tratta di combinare nel modo più rapido possibile l’identificazione delle opportunità e la decisione sulla migliore opzione d’azione e in ogni caso più veloce dell’avversario; tutto questo in modo ripetuto19.

È importante, soprattutto, evitare che la macchina neutralizzi le funzioni umane o di controllo se non è d’accordo, qualsiasi motivo esso sia, con la decisione dell’uomo. Questo non sarà certamente sempre facile, specialmente in aree in cui l’IA supererà l’intelligenza umana. Gli esseri umani dovrebbero sforzarsi di mantenere al centro la sicurezza delle popolazioni tenendo conto dell’IA.

Per il momento, l’IA dipende ancora da fattori di apprendimento che sono perlomeno iniziati dagli esseri umani. La capacità dell’intelligenza artificiale di reagire e risolvere situazioni nuove e inaspettate, essenziale per le forze armate, sarà un settore prioritario per lo sviluppo. Ciò dimostra tuttavia che sarà necessario sviluppare un nuovo sistema specifico di controllo degli armamenti per le armi autonome, soprattutto per quelle con effetti letali. Dobbiamo fare in modo che gli esseri umani possano disabilitare urgentemente un sistema autonomo che si discosta dalla sua missione. L’IA potrebbe causare problemi inaspettati a causa di effetti imprevedibili causati dalla velocità e dall’accumulo di interazioni. Nel contesto di questa inevitabile evoluzione, la responsabilità ultima per l’impiego di armi autonome deve rimanere in ogni caso con gli esseri umani, e non ci deve essere disimpegno20.

Uno dei maggiori pericoli insiti in questa evoluzione è che alcune decisioni, che richiedono reazioni molto rapide e indiscutibili, potrebbero essere delegate all’IA, come l’impiego di missili o di armi nucleari21. L’IA potrebbe quindi portare ad una nuova corsa agli armamenti, poiché tutti gli attori vorranno migliorare i loro sistemi d’arma con il potenziale dell’IA. L’uso crescente dell’IA sarà quindi un’evoluzione inevitabile, in primo luogo per i suoi benefici, ma anche con tutte le conseguenze nel campo della protezione. Gli esseri umani diventeranno meno determinanti e, allo stesso tempo, le macchine detteranno il ritmo del combattimento in tutte le aree operative e, soprattutto, ne influenzeranno direttamente il risultato. Gli esseri umani dovranno trovare un modo per mantenere il controllo del processo ed eventualmente porre dei limiti alle macchine o alla loro assistenza. Una guerra che utilizza missili autoguidati, carri armati e droni armati, possibilmente guidati a distanza, è un’opzione che deve essere presa in considerazione. Potremmo vedere una sorta di “disumanizzazione” delle guerre del futuro.

Nella conduzione delle operazioni, la tutela delle comunicazioni ha sempre svolto un ruolo essenziale. Tutto ciò ha un impatto positivo solo se è possibile garantire il funzionamento delle proprie comunicazioni allo stesso tempo.

Si può quindi presumere che l’eliminazione delle forze dell’avversario al fine di accaparrarsi la decisione perderà ancora più importanza a favore invece della capacità di raggiungere il cuore del sistema nemico, i suoi centri di gravità, o di attaccarlo per paralizzarlo. La capacità di riconoscere le finestre di opportunità sarà sempre più importante e decisiva.

Le «finestre» di opportunità possono essere create «accecando» o ingannando l’avversario. I sistemi di comunicazione delle forze armate contrapposte diventeranno quindi sempre più infrastrutture critiche essenziali. Il loro attacco e la loro distruzione sicuramente paralizzerebbero e quindi sconfiggerebbero gli avversari in un mondo in cui la competenza informativa e la capacità di manipolazione della stessa rappresenterà il vero potere.

Le «finestre» di opportunità possono essere create «accecando» o ingannando l’avversario. I sistemi di comunicazione delle forze armate contrapposte diventeranno quindi sempre più infrastrutture critiche essenziali. Il loro attacco e la loro distruzione sicuramente paralizzerebbero e quindi sconfiggerebbero gli avversari in un mondo in cui la competenza informativa e la capacità di manipolazione della stessa rappresenterà il vero potere.

La superiorità dello spazio di informazione sarà raggiunta attraverso una maggiore capacità di raccogliere dati, analizzandoli molto rapidamente e utilizzandoli immediatamente sul campo di battaglia. Ci saranno più fonti e sarà più facile diffondere informazioni false o influenzare le decisioni dell’avversario. La propaganda, l’inganno e l’ingegneria sociale, cioè la manipolazione psicologica su larga scala, saranno ottimizzati. Questo servirà anche a confondere l’avversario, interrompendo la sua percezione della situazione più sicuramente che distruggendo il suo equipaggiamento e i suoi sistemi d’arma. Le strutture di comando verticale lasceranno sempre più spesso il posto a strutture in rete altamente flessibili per integrare la cooperazione permanente o temporanea con nuove componenti. Ci saranno quindi certamente cambiamenti significativi anche nell’analisi dei centri di gravità e nella pianificazione degli obiettivi.

Sarà inoltre necessario un equilibrio nel settore delle armi informatiche e del sostegno all’IA che consentirà, come quella nucleare, una nuova forma di deterrenza informatica. Il periodo di transizione tra lo sviluppo di nuove capacità e l’equilibrio delle risorse sarà rischioso. Occorre tener conto del fatto che le applicazioni militari dei sistemi civili di IA non sono così facili da realizzare. La natura della duplicazione di queste tecnologie sarà un fattore importante, eventualmente anche limitante. Una delle dimensioni importanti per l’impegno di sistemi d’arma autonomi è il danno collaterale che potrebbero causare. Spesso si tratta di bilanciare gli interessi in gioco in questo campo, in un contesto che può evolvere ogni secondo. Non si tratta quindi solo della correttezza delle informazioni disponibili, ma di una valutazione di un sistema globale, con un’unica azione che può avere un impatto strategico. La questione dell’autonomia comprende anche la dimensione della responsabilità in relazione alla condotta e alle conseguenze degli impegni di sistemi d’arma autonomi. Alla fine, possiamo immaginare che nel contesto della difesa attiva, uno Stato possa reagire con una risposta solo parzialmente militare, cibernetica e non cibernetica, a cyber-azioni aggressive contro i suoi interessi.

fDi fatto, una protezione informatica funzionante e le capacità informatiche consentono all’esercito di svolgere i propri compiti, quindi di condurre le operazioni possibilmente in modo ancora più efficiente e a costi inferiori22.

L’importanza della difesa informatica per l’Esercito Svizzero

Una difesa informatica efficace e la protezione dei sistemi diventeranno nei prossimi anni la pietra angolare dell’effetto deterrente dell’Esercito Svizzero. Un avversario che non riesce a indebolirla con attacchi cibernetici ci penserà due volte prima di impegnarsi ulteriormente, coinvolgendo rispettivamente i suoi mezzi terrestri e aerei. La sicurezza informatica è essenziale come prima linea di difesa, in quanto può essere una forma di deterrenza contro gli attacchi negli spazi fisici il che non va tuttavia confuso con il concetto di deterrenza nucleare. L’obiettivo è quello di convincere un avversario a rinunciare a un attacco contrastando le operazioni preparatorie nel cyberspazio e nello spazio dell’informazione. Le misure che contribuiscono a questa convinzione devono pertanto essere promosse attivamente. Ciò è particolarmente vero nel caso in cui un avversario scelga una strategia ibrida, che inizia tramite l’indebolimento mirato dello Stato e delle sue forze armate attraverso la dimensione del cyberspazio. È necessario rendere difficile la vita di un potenziale aggressore aumentando i mezzi necessari per il proprio successo. La Svizzera, che non dispone più di un esercito di massa per scoraggiare un potenziale avversario, deve essere all’avanguardia della sicurezza informatica per proteggere i propri sistemi d’arma e le infrastrutture critiche, in modo da non essere indebolita prima di un conflitto. Avere sistemi che utilizzano l’IA possono anche essere un deterrente23.

La dipendenza dell’Esercito Svizzero dalle infrastrutture civili, in particolare dalle reti di comunicazione, è un fattore che giustifica pienamente lo sviluppo della sicurezza militare nel cyberspazio. È essenziale per l’esercito che anche queste infrastrutture siano ben protette. Da questo punto in poi, è importante integrare la difesa informatica in tutte le esercitazioni militari o di gestione delle crisi, in particolare quelle che coinvolgono anche partner civili. Le relazioni tra l’esercito e le istituzioni civili si intensificano sempre più in entrambe le direzioni, il che significa che in pratica, nell’ambito dell’architettura di sicurezza informatica, l’esercito potrà beneficiare anche del sostegno delle imprese civili, nella misura in cui non dipendono da esse. La ricerca all’interno di Armasuisse W+T deve inoltre dedicare maggiori risorse allo studio, allo sviluppo e all’integrazione dell’IA per poter contrastare la ricerca dell’avversario. Inoltre, per quanto riguarda il personale, non va dimenticato che le aziende civili e le forze armate saranno in competizione per gli stessi specialisti. Il sistema della milizia dovrà essere trasformato in un vantaggio, non in un handicap.

Eventuali scontri nel cyberspazio creeranno maggiori aspettative e vincoli per i leader a tutti i livelli, che dovranno essere in grado di agire autonomamente in un dato quadro globale. Chiunque utilizzi una “condotta ordinata” (Befehlstaktiktik) con le nuove tecnologie, ad esempio come strumento di controllo permanente per imporre una visione, ne uscirà sconfitto. Task Force modulari, altamente flessibili, con un’ampia gamma di impieghi possibili, in grado di adattarsi ad un avversario in continua evoluzione, sono le forze del futuro. In futuro l’Esercito Svizzero avrà bisogno di una struttura di comando molto flessibile, prevista come parte di un sistema di sistemi, in cui la leadership verticale lascia il posto alla leadership tematica, orizzontale e adattabile. È probabile che l’aumento dell’importanza del cyberspazio significhi una diminuzione dell’importanza del dominio del territorio e degli spazi fisici in generale. Questa evoluzione non è quindi insignificante e dovrà essere integrata nei futuri sviluppi dell’esercito anche perché la nozione di “terreno” è sempre stata di notevole rilevanza nella dottrina. La Cyber-guerra renderà ancora più importante anche l’analisi dei centri di gravità dell’avversario. Tale attività dovrebbe condurre ad uno sforzo massimo sulla protezione dei propri centri di gravità e sulla capacità di agire sui centri di gravità avversi. L’aiuto che l’IA può generare per lo svolgimento dei combattimenti nelle aree urbane sarà decisivo e portà essere un vantaggio notevole proprio perché tali aree rappresentano il principale terreno di intervento dell’Esercito Svizzero. A causa del rinnovo di molti sistemi d’arma nei prossimi 10-15 anni e del fatto che si prevede che saranno in uso per circa 30 anni, le sfide per la pianificazione degli acquisti saranno molto reali e non possono essere sottovalutate. Questioni come l’utilità futura di carri armati o altri mezzi pesanti come l’artiglieria dovranno essere affrontate. Tuttavia, sarà sempre necessario integrare la dimensione della sicurezza informatica e della ridondanza in caso di attacchi informatici nei processi di acquisizione di questi sistemi. L’Esercito Svizzero dovrà disporre di mezzi informatici adeguati per una preparazione ottimale del campo di battaglia o per bloccare la preparazione dello scenario di attacco di un possibile avversario. A causa degli impegni dell’Esercito Svizzero all’estero, sarà inoltre necessario individuare le possibilità e i limiti delle azioni nel cyberspazio contro avversari non convenzionali. Sarà inoltre necessario trovare il modo migliore possibile per garantire la sicurezza informatica delle truppe da impegnare in ambienti sfavorevoli. In sintesi, vi sono 8 sviluppi principali, con le implicazioni del cyberspazio e dell’IA, che interesseranno l’Esercito Svizzero e che dovranno quindi essere monitorati e integrati nella pianificazione dello sviluppo dell’esercito: (1) l’aumento del numero di robot, in tutti i settori, (2) l’abbandono di alcuni sistemi d’arma, sostituiti da nuove tecnologie, (3) nuovi metodi di combattimento derivanti dalle nuove tecnologie, (4) nuove armi, (5) nuovi criteri di potenza e strumenti, (6) la crescente autonomia delle macchine, (7) nuovi problemi legati alle macchine e infine (8) nuovi obiettivi

Conclusioni

La difesa informatica è diventata una necessità assoluta per proteggere non solo la popolazione e le infrastrutture, ma anche la vita sociale e democratica. Gli attacchi informatici sono la minaccia principale, sebbene questa minaccia sia stata finora mascherata dalla visibilità del terrorismo. Le nuove vulnerabilità appaiono più velocemente, prima che quelle vecchie vengano eliminate. Uno dei problemi principali sarà il costo di una protezione ad ampio spettro.

Gli sviluppi nel cyberspazio e il crescente utilizzo dell’IA in questo spazio operativo modificheranno i parametri a cui siamo abituati. Questo vale sia per gli aspetti civili che per quelli relativi alle forze armate. Le nuove minacce nel cyberspazio non sostituiscono quelle vecchie, ma si aggiungono a quelle già note che rimarranno ulteriori strumenti per attacchi per attori non statuali di ogni tipo (dirottamenti di aerei, imbarcazioni, ecc). Ma l’esercito è solo uno dei partner e può contribuire alla gestione di una crisi informatica con le proprie risorse, nella misura in cui le disposizioni di legge lo consentono. Non hanno quindi un ruolo guida in questo settore, rispettivamente non dovrebbero farlo se gli organismi civili svolgono il loro ruolo. Ciò non diminuisce la necessità di garantire la loro capacità di fornire i servizi previsti attraverso un’efficace protezione dei loro sistemi e quindi di riconsiderare rapidamente le priorità di assegnazione delle risorse. Il livello di sicurezza dei sistemi statali, compresi quelli delle forze armate, è una questione centrale. Un livello elevato è essenziale. L’intelligenza artificiale creerà nuove opportunità, rendendole accessibili a più attori. Caratteristiche geopolitiche come la dimensione del territorio, la popolazione e le risorse naturali non saranno più gli unici attributi del potere di un paese. La rivoluzione determinata dalle nuove tecnologie diffonderà e ridistribuirà il potere, il più delle volte a beneficio degli attori più piccoli e attualmente più deboli. Gli Stati più piccoli e alla punta dell’IA avranno un impatto maggiore24. Il pericolo principale sarà senza dubbio uno squilibrio delle risorse che potrebbe spingere uno Stato ad un atteggiamento aggressivo se ha la netta convinzione di vincere o di avere una superiorità nel cyberspazio. Sarà inoltre necessario un equilibrio nel settore delle armi informatiche e del sostegno all’IA che consentirà, come la deterrenza nucleare, una nuova forma di deterrenza informatica. La regolamentazione del cyberspazio è quindi essenziale per promuovere la cooperazione e consentire la repressione degli abusi. Gli Stati dovranno dotarsi dei mezzi per svolgere un ruolo normativo nel cyberspazio, che al momento sembra alquanto difficile. Se il divario tra Stati ricchi e Stati poveri continua ad aumentare, è prevedibile che si verifichino gravi crisi. I paesi poveri avranno sempre più mezzi per reagire agli abusi del sistema economico globale e saranno in grado, con mezzi relativamente limitati, di lanciare azioni aggressive nel cyberspazio contro coloro che vengono percepiti come oppressori o approfittatori. Ciò potrebbe generare rischi significativi di destabilizzazione e conflitti. La questione della responsabilità deve essere risolta il più presto possibile. Nel caso di un problema grave, e questo a causa della difficoltà di individuare un aggressore, sarà necessario essere in grado di attribuire la responsabilità dei fatti. Questo potrebbe essere il proprietario, il programmatore, il costruttore, l’emittente, o anche lo Stato. Questa è una delle più importanti questioni aperte in un mondo sempre più automatizzato. La difficoltà di attribuzione è un problema centrale, anche se può essere considerato come un fattore che calma il gioco, poiché costringe l’attaccante a rimanere misurato nella sua reazione. Tuttavia, questo richiederà anche una soluzione, poiché gli attacchi saranno sempre più efficaci, più precisi, più difficili da attribuire e mirati a tutte le vulnerabilità. Ci saranno anche più attori in grado di effettuare tali attacchi. Il miglioramento della sicurezza non solo deriva dalla necessità di fare le cose meglio, ma anche di farle in modo diverso. Saranno necessarie modifiche comportamentali per ridurre ed eventualmente eliminare i rischi. La sperimentazione è una fase che diventerà sempre più importante, sia per verificare i possibili guadagni in termini di sicurezza, sia per cercare le vulnerabilità al fine di eliminarle. Grazie alle sue crescenti capacità di apprendimento autonomo, l’IA potrebbe in un futuro abbastanza prossimo essere in grado di sviluppare e garantire la sicurezza informatica di un sistema in modo completamente autonomo, cioè senza alcun input umano necessario. Tuttavia, gli esseri umani manterranno un ruolo nel processo di machine learning. Una mancanza di interazione potrebbe portare allo sviluppo di macchine nella direzione sbagliata e potrebbe quindi ridurre l’efficacia della sicurezza. L’importanza dell’essere umano, e quindi del soldato, non scomparirà, così come le molte paure che accompagnano lo sviluppo dell’IA. Il rischio reale sarebbe quello di separare gli esseri umani e le macchine, il che porterebbe inevitabilmente a conflitti. Sarà essenziale che i sistemi militari diventino sufficientemente sicuri da compensare il diffuso aumento delle possibilità della minaccia digitale. È imperativo che tutti gli interessati siano consapevoli della gravità della minaccia. Il rischio nel cyberspazio è un rischio sistemico e non si limita a potenziali attacchi mirati o limitati. In questo contesto, la sicurezza informatica è un deterrente non solo contro gli attacchi informatici, ma anche contro gli attacchi in altre aree operative, poiché l’indebolimento di un avversario nel cyberspazio può essere utilizzato anche come preparazione a un conflitto aperto. Ci si dovrà abituare a un ambiente in cui gli attacchi informatici saranno comuni e sistematicamente tentati, il che potrebbe mettere a repentaglio la stabilità dell’intero ciberspazio. Di conseguenza, potrebbero esserci sempre più scontri tra sistemi, tutti supportati dall’IA, con alcuni che tentano di sfruttare le vulnerabilità altrui. La sicurezza nel mondo virtuale sarà la base per proteggere il mondo reale. Tuttavia, può darsi che l’entità potenziale del danno, compreso il danno collaterale, sia tale da rappresentare un fattore che possa indurre gli aggressori ad usare cautela, specialmente nel caso degli Stati. È infatti molto difficile stimare le conseguenze di attacchi informatici che colpiscono indiscriminatamente tutti i computer e i sistemi di un paese e i cui effetti collaterali sono per definizione imprevedibili. Questo scenario risulta essere del tutto ammissibile con armi autonome basate sull’IA e quindi non più controllate dall’uomo. L’esercito, e in particolare l’Esercito Svizzero, non ha altra scelta se non quella di proteggersi efficacemente dagli attacchi informatici e dalla diffusione di nuove tecnologie per poter continuare a svolgere la propria missione di protezione della popolazione e del territorio nazionale. È impossibile immaginare forze armate che non hanno una componente informatica. Sottovalutare le nuove sfide legate allo sviluppo del cyberspazio e dell’IA comporta rischi esistenziali per le società. Si possono e si devono adottare misure, spesso sostenute anche dall’IA, per rafforzare la sicurezza nel cyberspazio. Ci sono sei componenti per un’efficace protezione informatica:

(1) prevenzione,

(2) anticipazione

(4) individuazione,

(5) attribuzione e

(6) risposta.

La formazione degli “utenti di Internet” e dei media è centrale. L’anticipazione implica la conoscenza delle minacce, per essere in grado di prepararsi a contrastarle, mentre la protezione implica tutte le misure per complicare il compito degli aggressori. L’individuazione deve essere resa possibile dalle misure adottate all’interno dei sistemi stessi. Queste misure diventeranno più importanti, anche se potrebbero complicarsi con lo sviluppo della crittografia. L’assegnazione richiede mezzi specifici di analisi dei segnali. Infine, la reazione riguarda soprattutto i mezzi per riprendere e proseguire le attività, nonché le misure contro l’aggressore stesso.

Note:

1. Ryter, Marc-André: La 4ème révolution industrielle et son impact sur les forces armées, MPR I/17, pp. 50–62 (la versione italiana « La Quarta rivoluzione industriale ed il suo impatto sulle Forze Armate » è stata pubblicata in Cybersecurity Trends Italia 2/2018, pp. 14-25)

2. Rid, Thomas: The Rise of the Machines, Scribe Publications, London, 2016, p. 298.

3. Ryter, op. cit., pp. 58–60.

4. Straub, Jeremy: Artifi cial Intelligence is the weapon of the next Cold War, The Conversation, 29.01.2018, disponibile su: https://theconversation.com/artifi cialintelligence-is-the-weapon-of-the-next-cold-war-86086, p.2

5. Anil, Suleyman: How to integrate cyber defence into existing defence capabilities, in Angeli, Franco (Dir.): International Humanitarian Law and New Weapon Technologies, International Institute of Humanitarian Law, San Remo, 2012, p. 152.

6. Anil, op. cit., p. 149. +

7. Revue Stratégique de Cyberdéfense, Secrétariat Général de la Défense et de la Sécurité Nationale, Paris, 12.02.2018, disponibile su: http://www.sgdsn. gouv.fr/ uploads/2018/02/20180206-np-revue-cyber-public-v3.3-publication.pdf, p. 81.

8. Brundlage, Miles (et al): The Malicious Use of Artifi cial Intelligence: Forecasting, Prevention and Mitigation, February 2018, 99 p., disponibile su: https:// arxiv. org/ftp/arxiv/papers/1802/1802.07228.pdf.

9. Ibid, p. 21.

10. Ibid, p. 39.

11. Straub, op. cit., p. 3.

12. Arquilla, John et Ronfeldt, David: Cyberwar is coming!, Comparative Strategy, vol. 12, no 2, 1993, p. 39

13. Dannreuther, Roland: International Security: the Contemporary Age, Cambridge, Polity Press, 2013, p. 266.

14. Brundlage, op. cit., p. 43.

15. Rid, op. cit., p. 296.

16. Douzet, Frédérick: Cyberguerres et cyberconfl its, in: Badie, Bertrand et Vidal, Dominique: Nouvelles Guerres, L’état du monde 2015, La Découverte, Paris, 2014, pp. 111–117

17. Allen, Greg et Chan, Taniel: Artifi cial Intelligence and National Security, Harvard Kennedy Scholl, Belfer Center for Science and International Aff airs, July 2017, p. 46.

18. Villani, Cédric: Donner un sens à l’intelligence artifi cielle: pour une stratégie nationale et européenne, Mission parlementaire du 8 septembre 2017 au 8 mars 2018, Paris, mars 2018, p. 221, disponibile su: www.aiforhumnaity.fr.

19. Rid, op. cit., p. 300.

20. Brundlage, op. cit., p. 42.

21. Straub, op. cit., p.3.

22. Revue Stratégique de Cyberdéfense, op. cit., p. 52.

23. Straub, op. cit., p. 5.

24. Arquilla et Ronsfeldt, op. cit., p. 26